易翻译具备自动断句功能:它会把连续的文本或语音转写结果,按照语言习惯和语义边界插入标点与句子划分。实现上结合规则(标点、停顿、数字与专名处理)与神经网络模型(语义边界判断),并在不同场景(文本输入、语音实时、拍照取词、双语对话)采用各自的优化策略,同时提供手动调整和复核选项以减少误断。

先说清楚什么是“断句”

断句并不是简单地把一句话切成两段,它是把连续的语言流——无论是打出来的长串文字还是语音转写——按语法、语义和说话节奏,恢复成合乎阅读习惯的句子和段落。想像你在把长长的一条绳子剪成若干合适的段,既要考虑绳子的长度,也要按用途和节点来断。

断句包括哪几件事?

- 插入标点:把逗号、句号、问号等放到合适位置。

- 判断句边界:识别句子结束的位置,或者句中短停顿。

- 处理特殊项:数字、时间、缩写、专有名词、列举项要避免被误断。

- 语气与语义保持:保留原话的语气(疑问、感叹)和信息完整性。

易翻译如何做断句:体系化分层解释(费曼式)

把一个复杂系统拆成简单模块来讲,像拆玩具一样。易翻译的断句可以看成三层:输入处理层、边界判断层和输出修整层。

1. 输入处理层(预处理)

- 文本清理:去除多余空格、重复符号、OCR常见错字做简单纠错。

- 语音转写的时间戳和停顿信息:声学模型会提供停顿置信度,作为判定断句的重要线索。

- 语言检测:不同语言有不同断句规则,先确定语种再走对应流程。

2. 边界判断层(核心)

这是断句的大脑,混合规则与统计/深度学习方法:

- 规则引擎:基于标点、连接词、数词、时间表达式的启发式规则(比如“上午9点30分”内部不应断)。

- 机器学习 / 深度模型:Transformer/BERT 类模型通过上下文预测是否为句末边界,考虑语义连贯性。

- 融合策略:当规则与模型冲突时,会依据可信度(例如ASR的置信度、OCR识别置信度)选择最终方案。

3. 输出修整层(后处理与用户交互)

- 标点规范化:统一中英文标点样式。

- 短语保护:防止专名或数字被拆散。

- 用户可编辑:给出建议断句,用户可手动修正并保存为偏好。

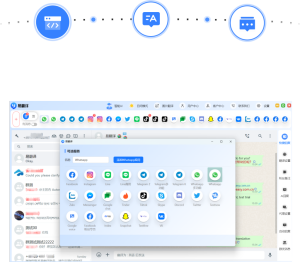

在四大核心场景中断句的差别

易翻译的四大功能模块——文本输入、语音实时互译、拍照取词、双语对话——对断句的侧重点不同。我分开解释,方便你理解为什么同一句话在不同场景下会有不同表现。

文本输入翻译

文本输入通常是最“干净”的场景。断句依赖于已有标点和上下文,主要处理长句断开与合并、标点缺失时的智能补全。

- 优点:上下文完整,模型判定更准确。

- 常见问题:用户粘贴无标点长句(如chatlog),需要更强的语义推断。

语音实时互译

语音场景最具挑战性:ASR(语音识别)先把声音转成文本,断句要靠停顿、声学特征与语言模型共同判断。

- 利用停顿长度和重音来决定是否断句。

- 噪声、口音、连读会降低准确率。

- 实时性要求高:要在延迟和准确率间做权衡。

拍照取词(OCR)

从图片识别文本后断句,问题在于OCR可能丢字符或识别错误,标点位置可能不准确。

- 策略:结合字体和排版信息(换行、段落间距)进行推断。

- 需要把断句与文本重构(如表格里的单元合并)联合考虑。

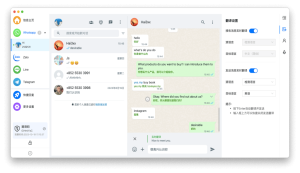

双语对话翻译

双语对话里,断句不仅要对原语句分割,还要保证译文流畅,往往需要重组句子顺序以符合目标语言习惯。

举例说明(直观感受)

| 原始无标点 | 我今天早上去了图书馆遇到老王他还带了他的小孩 |

| 断句后 | 我今天早上去了图书馆,遇到老王,他还带了他的小孩。 |

| 说明 | 在中文中,根据语义短停顿(“遇到”)插入逗号,更利于阅读;最后加句号。 |

再看一个语音例子(含停顿):

- 语音(带短暂停顿):”我们下周一……开会,讨论预算。” —— 系统会把“下周一”视作时间短语,不断句,而在“开会,讨论预算”处断句。

技术细节和常见算法(浅析,不晦涩)

如果把断句比作做一道菜:规则是食谱,模型是厨师的经验。常见用到的技术:

- 条件随机场(CRF):曾在序列标注任务中流行,用于按词判断边界。

- BiLSTM + CRF:在深度学习早期做过很多断句/分词任务。

- Transformer / BERT:通过上下文注意力判断更复杂语义边界,现在是主流。

- CTC 与声学模型融合:语音场景下,CTC帮助映射时间序列到词序列,停顿信息参与断句决策。

为什么有时候断句会出错?常见误区与原因

- 口语化表达:断句依据书面规则,但口语常常语法不完整或省略主语。

- 专有名词中含有停顿信号:比如“C++”或“U S A”识别成单词间隔导致错误。

- 数字和时间的格式:如“3.14”和“3,14”在不同语言意义不同,可能被误断。

- ASR或OCR错误:基础识别错误会直接影响断句。

- 多语言夹杂:一句话中同时出现中英混杂,断句模型若未训练充分会混淆规则。

易翻译在断句效果上常见的性能与现实表现

没有单一的“准确率”能覆盖所有场景,但可以描述典型范围(实际取决于音质、图片质量、输入难度):

- 文本输入(普通书面语):断句准确率通常在95%+。

- 语音实时(良好录音、普通话/标准英语):断句率常在85%~95%。噪声或方言会下降。

- 拍照OCR(清晰印刷文本):断句准确率可达90%+,手写或模糊会低很多。

- 双语对话(实时翻译并断句):因为同时要翻译,流畅度可能优先于严格的语法断句。

用户可采取的实际操作建议(提升体验)

- 尽量提供清晰输入:有标点的文本、干净的语音录音、清晰的图片会显著提升断句质量。

- 使用手动校正功能:若断句结果不满意,及时手动修正并保存为常用句式偏好。

- 分段输入长文本:对于长篇内容,分段输入能减少误断和语义混淆。

- 标注专有名词与数字格式:在必要时用引号或空格标注特殊表达,帮助模型识别。

隐私与离线考虑

断句依赖模型和数据,涉及用户隐私时需要注意:

- 在线服务会把数据发到服务器做更强的模型推断;如果关注隐私,查找是否有本地离线模式。

- 一些应用支持离线ASR与断句模块,虽然模型容量受限,但可满足基本需求。

常见问题答疑(贴近日常)

Q:语音翻译为什么有时都不分句?

A:可能系统设置为逐字输出或低置信度时为了不误判而不插入标点。你可以在设置里切换“实时流畅输出”或“逐句输出”。

Q:拍照取词后句子很乱,怎么办?

A:先检查OCR识别置信度,必要时手动纠正关键名词或数字,或者拍摄更清晰的图片并选择“段落识别”选项。

对比表:不同场景下的断句策略速览

| 场景 | 主要线索 | 优先策略 |

| 文本输入 | 已有标点、上下文完整 | 语义模型 + 标点补全 |

| 语音实时 | 停顿、声学特征、ASR置信度 | 停顿阈值 + 模型预测 |

| 拍照OCR | 排版、换行、识别置信度 | 布局信息 + 语义重构 |

| 双语对话 | 双语语序差异、语用信息 | 重组译文以符合目标语言流畅度 |

未来发展方向(简短猜想)

- 更紧密的多模态融合:把声学、视觉(唇动)、语义一并用来断句。

- 个性化断句:根据用户阅读习惯调整断句风格(更口语化或更书面化)。

- 低资源语言的断句改进:借助跨语言迁移学习提高小语种表现。

好了,就写到这里,想着还能再说几句生活化的例子来说明,但怕啰嗦。总之,易翻译的断句并非单一规则,而是规则与模型的结合,并在不同场景里做出取舍,用户若配合清晰输入与适当手动校正,体验会好很多。你要是愿意,我可以把上面讲的那几个典型错误举更多具体句子来演示,或者帮你测试一段语音/文本看看断句效果如何。