用拍照取字、实时识别、截屏导入三种方式可取词:对准文字拍照或开启实时相机,软件先进行图像增强、文字检测与字符识别(OCR),再匹配语言与翻译引擎给出结果。取词后可拖动框选、放大校对或手动修改,识别率受光线、字体、排版影响,必要时切换语言或重拍。使用时注意隐私设置与离线包支持。推荐

先说结论(像跟朋友解释那样)

想象你把页面上的文字“摘”下来,易翻译就像一把放大镜加上一个懂很多语言的朋友:先把图片里的字找出来(像拼图),把每一块字识别成可读文本,然后交给翻译大脑去翻。你要做的,通常只有把相机对准、框选或点一下,必要时修正几个字符就好。

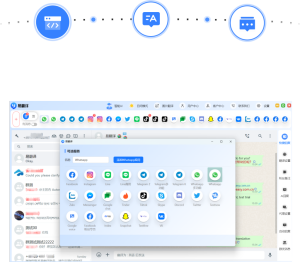

操作模式一览

易翻译常见的取字方式主要有三类,每种适合的场景不一样:

- 拍照取词:对准书页、海报、菜单拍一张,系统从照片中提取文字并翻译。适合静止文本,光线允许时最稳。

- 实时相机(实时互译):打开相机,实时识别并在屏幕上叠加翻译结果。适合旅行看标牌或即时交流。

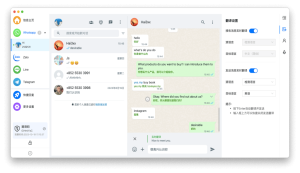

- 截屏/导入图片:把手机截图或导入图片,软件从已有图像中识别文字。适合APP内截取对话、网页、电子票据等。

简单操作步骤(一步步来)

- 打开易翻译,选择拍照/实时/导入模式。

- 允许相机与存储权限(首次使用时会请求)。

- 对准文字,点击拍照或等待实时识别画面稳定。

- 软件自动框选文字区域,你可以拖动框、放大图片或手动涂选要取的词句。

- 确认识别结果(可编辑纠错),选择目标语言查看翻译。

- 需要可复制、收藏或发给别人。

底层是怎么工作的(用通俗比喻)

别被“黑箱”吓到,整个过程像四个流水工序:照相—清理—认字—翻译。

- 拍照/导入:先把要识别的“纸”拍成图片。

- 图像预处理:调整亮度、对比、去噪、校正倾斜(像把皱巴巴的纸摊平)。这一步是为了把字变得更清楚,方便后续识别。

- 文字检测与字符识别(OCR):先找到文字块,再把每个字符“读”成字母或汉字。现代OCR用的是卷积神经网络和序列模型,能处理连写或不规则排版,但对手写体和复杂背景仍然挑战较大。

- 语言检测与翻译:识别出的文本会先判断源语言,再交给神经网络翻译模型(NMT)进行翻译,最后把结果展示在界面上。

为什么有时候识别不准?

这里讲得像讲咖啡机故障——问题通常出在“原料”(图片)上:

- 光线太暗或逆光:相机看不清边缘,OCR难以分辨字符。

- 字体特殊或手写:模型训练样本少,识别能力下降。

- 排版复杂(多栏、曲面、纵排):文字检测阶段容易把行断掉或混淆。

- 反光、模糊或低分辨率:关键细节丢失,识别错误。

功能对照表(直观比较)

| 模式 | 适用场景 | 优点 | 限制 |

| 拍照取词 | 书籍、菜单、说明书 | 高质量图片、可重拍、可裁剪 | 需静止、拍摄质量依赖手法 |

| 实时相机 | 路牌、对话、指示牌 | 即时反馈、操作快速 | 复杂背景时跳动或错识别 |

| 截屏/导入 | 聊天记录、网页内容、电子单据 | 无需拍照、直接提取高分辨率文字 | 图片中若为矢量图或加密文本OCR仍有限制 |

实用小技巧(那些你试了会后悔没早点知道的)

- 先选语言:如果你知道源语言,先手动设定识别语言,会提高准确率。

- 靠近一点再拍:不要数字变糊,拍清楚比拍远更重要。

- 把纸摊平:曲面书页要按住或把照片从侧面稍调整角度再拍。

- 多拍几张:同一段文字拍两张或三张,挑最清晰的一张做识别。

- 用裁剪减少干扰:先裁掉不相关的图案或背景再识别。

- 遇到手写或复杂字体:尝试切换到“手写模式”或手工输入关键字。

- 离线包:在可能无网络的地方,提前下载目标语言的离线识别/翻译包。

常见问题和处理方法(QA式)

- 识别后出现错别字:手动编辑识别文本,或重拍并提升光照。

- 多列或竖排文本混在一起:尝试选中单列区域或将图片旋转再识别。

- 识别不到特殊符号/表格:表格内容建议导出为截图后逐行识别或手动输入部分关键项。

- 隐私担心:开启离线识别或在设置里关闭上传/云端保存功能。

进阶用法(更像技巧集)

有时候你会需要批量处理或把识别与其它工具联动:比如把识别结果批量导出成文本,再用文档翻译或做术语替换。还有些场景可以结合截屏工具与任务自动化(这事儿有点技术活),不过多数人直接用APP里的“历史/收藏”就够用了。

针对特殊场景的小提示

- 菜单上有艺术字体:把相机稍微拉远,多拍一张,或尝试文字放大后手动修正。

- 屏幕上的字幕闪动:用截屏模式捕捉画面再识别。

- 标牌在远处:用相机放大(光学优先)或靠近拍摄,实时模式下等待框稳住再截取。

隐私与数据安全(别忽略)

很多用户会问“我的照片会不会被传到云端?” 答案取决于设置和具体实现:

- 有的功能(特别是更复杂的翻译或大语言模型)需要云端计算,图片或文本会短期上传;有的功能支持离线包,所有数据都留在手机。

- 建议在处理身份证、合同等敏感信息时关闭云上传,使用离线识别或本地导出后再手动处理。

- 查看APP权限与隐私政策,确认是否启用了自动备份或诊断数据上传,按需关闭。

一些常见误解(别被坑)

- “拍照越清楚翻译就一定完美” —— 清楚能提高识别,但翻译本身还受术语、上下文影响。

- “OCR能读所有手写” —— 现代手写识别在改善,但草书、潦草笔迹仍常误判。

- “实时模式无需校对” —— 实时显示便捷,但建议在重要场合拍照并复核识别文本。

举个小例子(实际操作演示,想象场景)

你在国外餐厅,看到菜单上有一道长的菜名,眼睛又不够快。做法大概是:打开易翻译实时模式,对准菜单,等软件用黄色框把菜名圈住,点一下“取词”或者直接拍照,软件把识别的中文或原文列出来,你点“翻译”就得到中文解释。觉得翻译怪怪的?那就点编辑,把“kurobuta”这种专有名词保留再查资料——嗯,这步经常需要手动干预。

写到这里,想到一个小事实:OCR的精度在过去十年里提升很快,但实际体验往往还受场景和用户手法影响。所以别太苛求它像读书一样完美,有时候多拍几张或人工修正两三处,效率比执着追求一次识别完整更高。要是你愿意,我还能把一些具体场景的拍照示例写出来(像我刚才边想边写的那种),不过先试试这些方法,感觉怎么样?